얼마 전 팀 리드 친구한테 연락이 왔다. 요지는 이랬다. “PR이 쌓여서 배포가 3일씩 밀리는데 어떻게 해야 해?”

현장에서 15년 굴러다니다 보면 이런 SOS를 진짜 자주 받는다. 근데 문제는 항상 같다. 코드 리뷰 프로세스가 엉망이거나, 아예 없거나, 있어도 형식적이거나. 그래서 오늘은 술자리 안주처럼 허심탄회하게, 2026년 현재 실무에서 진짜 먹히는 코드 리뷰 베스트 프랙티스를 다 꺼내 놓으려고 한다. 공식 문서 번역본 말고, 현장에서 피 흘리며 쌓은 진짜 이야기다.

- 🔥 코드 리뷰, 왜 지금 더 중요해졌나? (2026 데이터 공개)

- 📐 PR 크기부터 틀렸다 — 400줄 법칙의 비밀

- ⚡ 리뷰 속도 벤치마크: 엘리트 팀 vs 평균팀 비교표

- 🤖 AI가 코드 짜는 시대, 리뷰어는 뭘 봐야 하나

- 💬 피드백 잘못 달면 팀 분위기 박살난다 — 커뮤니케이션 전략

- 🛠️ 2026년 코드 리뷰 도구 완전 비교 (CodeRabbit, Qodo, Greptile)

- 🚫 절대 하지 말아야 할 코드 리뷰 실수 7가지

- ❓ FAQ

🔥 코드 리뷰, 왜 지금 더 중요해졌나? (2026 데이터 공개)

솔직히 말하자. 예전엔 코드 리뷰를 “귀찮은 관문” 정도로 봐도 어느 정도 굴러갔다. 근데 2026년은 다르다.

2026년 기준, 전문 개발자의 51%가 AI 코딩 도구를 매일 사용한다. GitHub Copilot, Cursor, Claude Code가 밥 먹듯이 코드를 쏟아내는 환경에서, 2026년 기준 전체 코드 커밋의 41%가 AI 보조로 작성되고 있으며, AI가 생성한 코드의 결함률은 사람이 작성한 것보다 1.7배 높다. 코드 생성 속도는 폭발적으로 빨라졌지만, 리뷰 역량은 그 속도를 따라가지 못해 2026년 기준 품질 격차가 40%에 달할 것으로 전망된다.

더 무서운 건 이거다. AI 도입의 부작용에 대한 이야기는 거의 없는데, 실제 부작용은 팀이 PR에 파묻혀 빠르게 리뷰를 따라잡지 못하고 있다는 것이다. 즉, AI가 코드 생산 속도는 올려줬는데, 리뷰 병목이 새로운 적이 된 셈이다.

코드 리뷰는 단순한 품질 게이트가 아니라 지식 공유, 멘토링, 건강한 코드베이스 유지를 위한 핵심 메커니즘이다. 그러나 많은 팀에서 이는 마찰과 지연으로 가득 찬 병목이 되어버린다.

📐 PR 크기부터 틀렸다 — 400줄 법칙의 비밀

가장 기본적이고, 가장 많이 무시당하는 규칙이다. PR 크기. 팀장한테 “리뷰 좀 제대로 해줘”라고 말하기 전에, 본인이 올리는 PR부터 보자.

확장 가능한 코드 리뷰의 4가지 필수 원칙이 있다: PR은 400줄 이하로 유지하고, 첫 리뷰는 6시간 이내에 완료하며, 모든 객관적 검사는 자동화하고, 명확한 원칙 기반 정책으로 프로세스 전체를 이끌 것.

이러한 검증된 관행을 무시하는 엔지니어링 팀은 느리고 집중력 없는 리뷰로 인해 팀 속도의 20~40%를 허비한다. 반면 DORA 엘리트 퍼포머들은 400줄 상한선을 지키고, 6시간 이내에 리뷰를 완료하며, 자동화로 리뷰어가 아키텍처 인사이트에 집중할 수 있도록 한다.

실제 현장에서 이야기하자면 — PR 1,500줄짜리 올리고 “리뷰 부탁드립니다” 하는 순간, 리뷰어는 속으로 욕하고 있다. 눈으로는 훑지만 두뇌는 이미 꺼져있다.

개발자들은 비효율적인 워크플로우와 씨름하느라 주당 평균 5.8시간을 허비하며, 이는 스프린트 목표를 날리는 병목을 만들어낸다.

⚡ 리뷰 속도 벤치마크: 엘리트 팀 vs 평균팀

Google, Meta와 같은 엔지니어링 조직은 일관되게 24시간 이내에 리뷰를 완료하며, 대개 훨씬 더 짧다. LinearB는 12시간 이내를, 진정한 DORA 엘리트 팀은 평균 6시간 이내를 목표로 한다.

| 항목 | 🟢 DORA 엘리트 팀 | 🟡 평균 팀 | 🔴 하위 팀 |

|---|---|---|---|

| 첫 리뷰 응답 시간 | 6시간 이내 | 12~24시간 | 1~3일 |

| PR 크기 (LOC) | 400줄 이하 | 400~800줄 | 800줄 초과 |

| 자동화 수준 | 린터+CI+AI 리뷰 완전 자동화 | 린터+CI 부분 자동화 | 수동 위주 |

| 리뷰 라운드 수 | 평균 1~2회 | 평균 3~4회 | 5회 이상 |

| 팀 속도 손실 | ~5% 이하 | ~20% | 20~40% |

| 리뷰 문화 | 학습·지식 공유 중심 | 버그 발견 중심 | 형식적·의무적 |

Google의 900만 건 리뷰 데이터셋은 코드 리뷰의 주된 이점이 단순한 버그 탐지가 아닌 지식 분배와 깊은 이해에 있다는 것을 증명했다. Microsoft와 Meta도 동일한 결론을 내렸다: 대부분의 리뷰 논의는 설계 선택, 아키텍처, 공유된 이해에 집중된다.

🤖 AI가 코드 짜는 시대, 리뷰어는 뭘 봐야 하나

여기서 많은 시니어들이 헷갈린다. AI가 코드를 짜주면 리뷰가 쉬워질 것 같지? 오히려 반대다.

구문 오류와 기본 로직 결함을 잡는 것에 집중했던 전통적인 리뷰 모델은 이제 낡은 것이 됐다. AI가 그 작업을 대신하기 때문이다. 이제 우리의 역할은 AI보다 더 나은 린터가 되는 것이 아니라, AI보다 더 인간적이 되는 것이다.

2026년의 코드 리뷰는 정확성(AI의 영역)보다 컨텍스트, 결과, 창의성에 집중해야 한다.

AI 코드를 리뷰할 때 특히 조심해야 할 것들이 있다.

가장 위험한 것은 ‘그럴듯한 환각(Plausible Hallucination)’이다 — 코드가 올바르게 보이고, 실제처럼 보이는 API 호출이나 내부 클래스를 사용하지만 정확히는 존재하지 않거나, 당신의 코드베이스에 구식인 패턴을 구현한다. 맥락을 파악한 사람의 리뷰만이 유일한 해결책이다.

또한 과잉 엔지니어링과 ‘영리한 복잡성’도 주의해야 한다. AI 모델은 방대한 데이터로 훈련됐기 때문에 종종 일반적인 엔터프라이즈 수준의 패턴으로 기본 설정된다. 불필요한 추상화 레이어, 단순한 함수로 충분한 곳에 디자인 패턴이 적용된 경우, 비대한 의존성을 리뷰해야 한다.

실질적인 접근법: AI 기여 로그를 유지하고, 엔지니어링 가이드라인에 ‘AI 코딩 표준’ 부록을 만들며, AI가 생성한 코드 대비 사람이 리뷰한 코드의 비율을 추적하라.

💬 피드백 잘못 달면 팀 분위기 박살난다 — 커뮤니케이션 전략

기술적으로 완벽한 팀이 코드 리뷰 문화 하나 때문에 와해되는 걸 봤다. 피드백은 기술이다. 그냥 생각나는 대로 다는 게 아니다.

많은 사람이 코드 리뷰의 주된 목적을 ‘버그 발견’이라고 생각하지만, 실제로 코드 리뷰에서 발견되는 결함의 대부분은 논리적 버그보다는 설계 문제, 가독성 이슈, 유지보수성 부족이다.

현장에서 검증된 피드백 프레임

- [Blocker] — 이건 머지 절대 불가. 보안 취약점, 로직 오류, 데이터 손실 위험.

- [Suggestion] — 더 나은 방향이지만 저자 판단에 맡김. 설명 필수.

- [Nit] — 사소한 제안에는 “Nit:” 코멘트를 활용하라. 이는 피드백을 건설적이고 비차단적으로 유지한다.

- [Question] — 이해가 안 돼서 묻는 것. 비판이 아님을 명확히.

리뷰어는 무엇을 바꿔야 하는지뿐만 아니라 왜 그 변경이 권장되는지에 집중해야 한다. 더 깊은 맥락을 제공하기 위해 문서, 스타일 가이드, 관련 아티클로 링크를 걸어줘라.

코드에 집중하고, 개발자에 집중하지 마라. “이 함수를 가독성을 위해 리팩터링하는 것을 고려해보세요”와 같은 표현을 써라. PR을 집중적으로 유지해 인지 과부하를 줄이고 결함 탐지율을 높여라.

파킨슨의 사소함 법칙(Law of Triviality)을 조심하라. 변수명이나 공백 같은 사소한 문제는 토론하기 쉽기 때문에 과도한 시간이 쏟아지고, 설계 결함이나 성능 문제는 놓치는 함정이다.

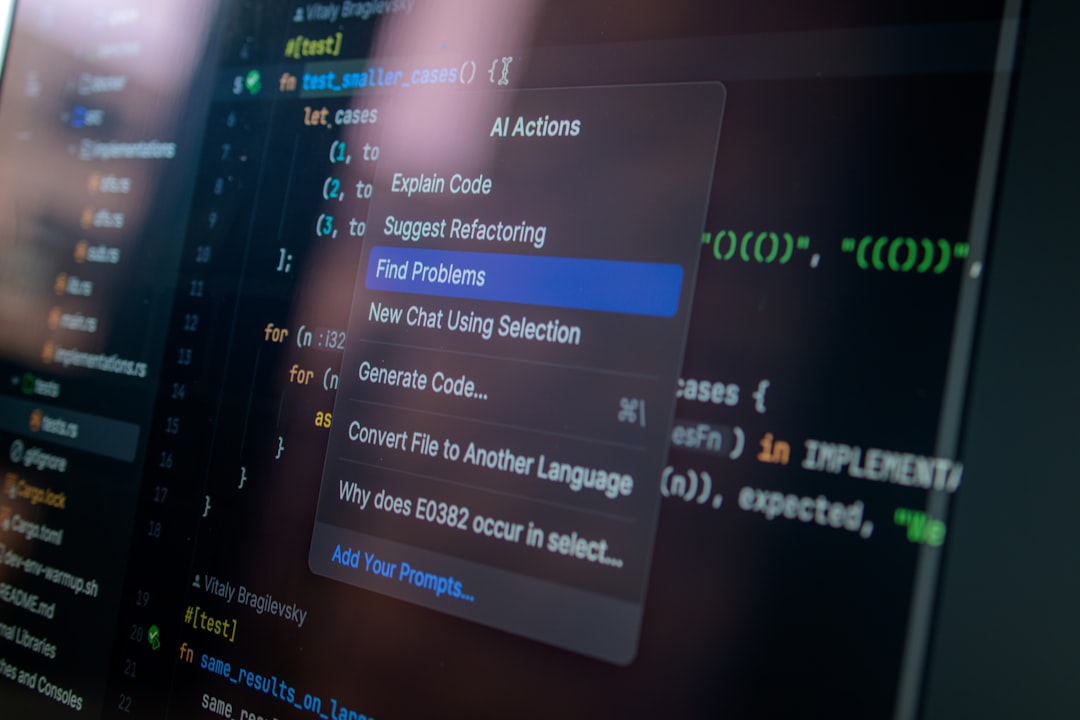

🛠️ 2026년 코드 리뷰 도구 완전 비교

도구 선택을 대충 하는 팀치고 리뷰 프로세스 잘 굴러가는 팀 못 봤다. 2026년 현재 주목할 만한 도구들을 정리했다.

| 도구 | 핵심 특징 | 강점 | 주요 고객 / 실적 |

|---|---|---|---|

| CodeRabbit | PR 오픈 시 자동 전체 분석 | 버그·보안·스타일 자동 탐지, 아키텍처 수준 피드백 | 오픈소스 100만+ 저장소, 기업 8,000+ 고객 |

| Qodo | 코드베이스 전체 영향 분석 + 룰스 시스템 | AI 리뷰 독립 벤치마크 1위 (Claude 대비 25점↑) | Walmart, NVIDIA, Ford / 엔터프라이즈 1년 11배 성장 |

| Greptile | 저장소 그래프 구조 파악, 딥 인덱싱 | 숨은 의존성 탐지, 모듈 간 영향 추적 | 시리즈A $2,500만, 기업가치 $1.8억 |

| GitHub Advanced Security | 정적 분석 + Secret 스캔 | 기존 GitHub 워크플로 네이티브 통합 | GitHub 전체 생태계 |

| Augment Code | Context Engine, 40만+ 파일 인덱싱 | 코드 리뷰 품질 F-score 59% (최고 수준) | 대규모 모노레포 환경 |

실제로 CodeRabbit을 도입한 그루폰(Groupon)은 코드 리뷰에서 프로덕션까지 걸리는 시간이 86시간에서 39분으로 줄었다. 수치가 말 다 해준다.

GitHub Advanced Security, GitLab Code Quality, Reviewpad 같은 도구들은 코드 리뷰를 수동 프로세스에서 문제를 조기에 발견하고 팀 표준을 강제하는 반자동화 워크플로로 변환했다.

🚫 절대 하지 말아야 할 코드 리뷰 실수 7가지

이것만 피해도 팀 리뷰 문화 반은 먹고 들어간다. 현장에서 직접 목격한 것들만 골랐다.

- ❌ PR 올리고 리뷰어 지정 안 하기 — 리뷰어가 없으면 리뷰도 없다. CODEOWNERS 파일 설정은 필수.

- ❌ 800줄 넘는 PR 올리기 — 비대한 PR과 느린 리뷰는 팀 배포 속도의 최대 40%를 갉아먹는다. 기능 단위로 쪼개라.

- ❌ 코드가 아닌 사람을 비판하는 코멘트 — “왜 이렇게 짰어?”식의 코멘트는 심리적 안전감을 파괴한다. 커뮤니케이션 훈련 부재가 원인이다.

- ❌ 완벽주의를 위해 모든 PR을 블로킹 — 완벽함을 추구하며 모든 PR을 막는 것은 진척을 늦추고 생산성을 해친다. 개선을 목표로 하되, 완벽을 목표로 하지 마라.

- ❌ AI 생성 코드를 묻지도 따지지도 않고 Approve — AI는 회사의 데이터 거버넌스 정책을 이해하지 못하며, API 키를 하드코딩하거나, 민감한 데이터를 로그로 남기거나, 검증되지 않은 외부 라이브러리를 제안할 수 있다.

- ❌ 스타일 논쟁을 리뷰에서 하기 — 코드 스타일 자동화가 부족하거나 리뷰 우선순위 기준이 없으면, 사소한 문제가 리뷰를 삼킨다. 린터와 포매터가 할 일을 사람이 하지 마라.

- ❌ 리뷰 기준 없이 매 라운드마다 새로운 피드백 쏟아내기 —

📚 관련된 다른 글도 읽어 보세요

- Cloud Native Application Design Principles in 2026: What 10 Years in the Trenches Actually Taught Me

- 6G Technology in 2026: Where Are We Now and What’s Coming Next?

- Clean Architecture vs Hexagonal Architecture: Which One Actually Wins in 2026?

태그: []