Picture this: it’s Tuesday morning, your sprint planning just wrapped up, and your lead engineer is already buried under three Slack threads, two conflicting pull request reviews, and a CI/CD pipeline that’s been flashing red since yesterday. Sound familiar? This isn’t a 2019 problem anymore — it’s a 2026 reality for most engineering teams, and honestly, the tooling landscape has never been more crowded or more capable of solving it.

I’ve spent the last several months digging into what teams are actually using, what’s delivering ROI, and what’s just adding to the noise. Let’s think through this together.

Why Productivity Tooling Has Become Non-Negotiable in 2026

According to a McKinsey Technology Report released in early 2026, engineering teams that adopt integrated developer experience (DevEx) platforms see an average 34% reduction in context-switching time and a 22% increase in deployment frequency within six months. That’s not marginal — that’s the difference between shipping a feature in a two-week sprint and a four-week one.

The shift matters because engineering talent remains expensive and competitive. The average fully-loaded cost of a senior software engineer in North America in 2026 sits around $280,000–$340,000 annually. When you do the math, even a 15% productivity gain per engineer pays for most premium tooling subscriptions many times over.

The Core Categories You Should Be Evaluating

Rather than throwing every popular tool at you, let’s break this down into the categories that genuinely move the needle:

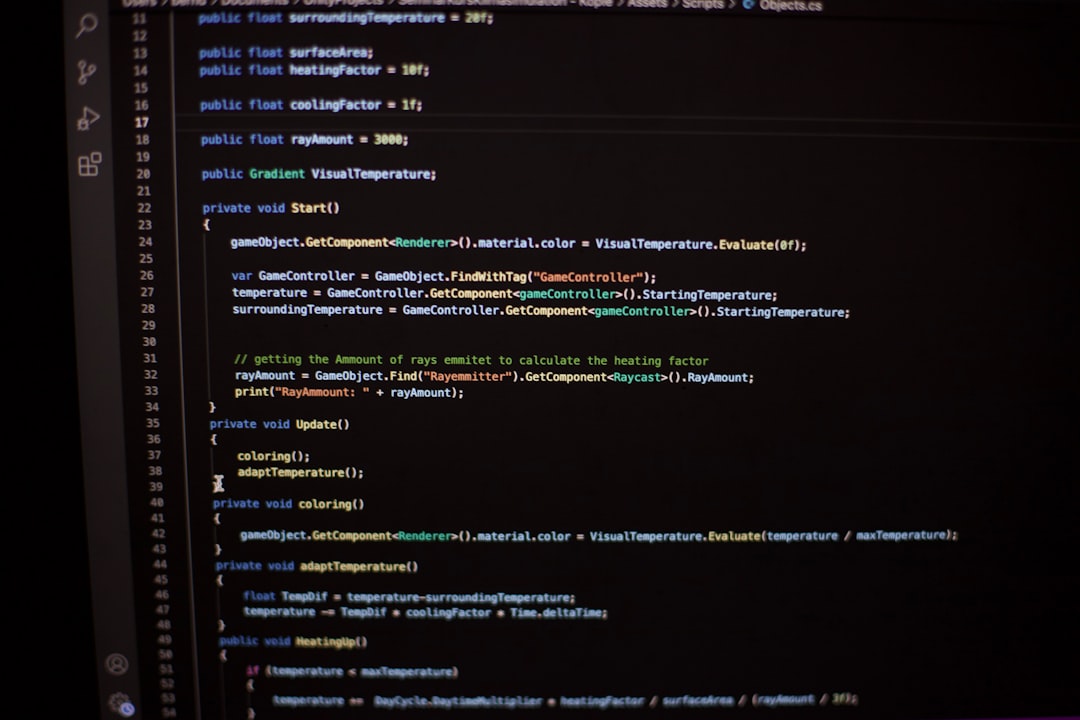

- AI-Assisted Coding & Review: GitHub Copilot Enterprise, Cursor Pro, and the newly released JetBrains AI Full Stack have matured significantly. In 2026, these aren’t just autocomplete toys — they’re context-aware agents that understand your entire repository architecture. Teams at Shopify and Stripe have reported 40%+ reductions in boilerplate writing time.

- Async Communication & Documentation: Linear combined with Notion AI or Confluence’s new intelligent summarization features is a combination I’m seeing win repeatedly. The key is reducing meeting load — tools like Loom AI now auto-generate action items and link them directly into your project tracker.

- CI/CD & DevOps Intelligence: Platforms like Buildkite and Harness now include predictive pipeline failure analysis. Instead of waiting 45 minutes to discover a broken build, your team gets a flagged warning before a merge even happens.

- Observability & Developer Feedback Loops: Datadog’s 2026 DevEx suite and Grafana Cloud’s unified dashboards make it possible for developers — not just ops teams — to own their service reliability metrics in real time.

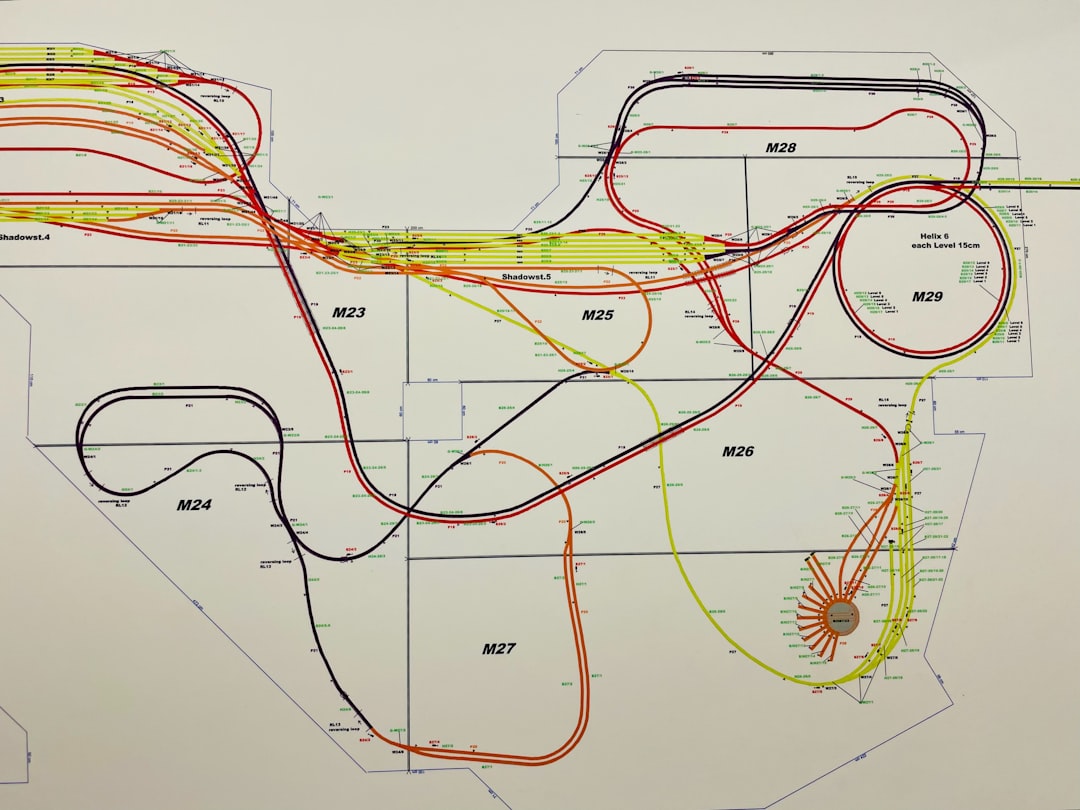

- Team Health & Flow Analytics: This is the category most teams overlook. Tools like Swarmia and LinearB analyze Git activity, review cycles, and deployment patterns to surface bottlenecks quietly killing your team’s momentum. No surveillance vibes — think of it as a team fitness tracker.

Real-World Examples: Who’s Doing It Right

Kakao (South Korea) — One of Korea’s largest tech companies publicly shared in their 2026 engineering blog that adopting a unified internal developer portal (IDP) built on Backstage.io reduced onboarding time for new engineers from an average of 6 weeks to just 2.5 weeks. That’s a 58% reduction, achieved largely by centralizing documentation, service ownership, and deployment pipelines in one place.

Vercel (USA) — The frontend infrastructure company reorganized their engineering squads in early 2026 around a “Golden Path” approach — standardizing tool stacks so teams weren’t constantly debating which observability tool or testing framework to use. The result? Their median time-to-merge for pull requests dropped from 3.2 days to 1.4 days in one quarter.

Zalando (Germany) — Zalando’s platform engineering team published a case study showing that embedding AI code review assistants (specifically a fine-tuned version of CodeRabbit) into their PR process reduced critical bug escapes to production by 31% year-over-year in 2026.

The Hidden Trap: Tool Sprawl

Here’s where I want to be honest with you — adding more tools isn’t automatically better. There’s a real phenomenon called tool sprawl, where teams accumulate subscriptions that each solve a narrow problem but collectively create integration nightmares and cognitive overhead. I’ve seen teams paying for seven different project management tools simultaneously.

Before you invest, ask: Does this tool integrate natively with our existing stack, or will it require custom glue code to be useful? That glue code has a maintenance cost that never shows up in the vendor demo.

Realistic Alternatives Based on Team Size & Budget

Not every team has the budget of a Shopify or Zalando. Here’s how I’d think about it:

- Small teams (2–10 engineers): Start with Linear for project tracking, GitHub Copilot for AI assistance, and Loom for async communication. Total cost stays under $100/month and covers the highest-impact categories without overwhelming complexity.

- Mid-sized teams (10–50 engineers): Add a flow analytics tool like Swarmia and invest in a solid observability stack (Grafana Cloud’s free tier scales surprisingly well). Consider an IDP like Backstage only if you have someone willing to own its maintenance.

- Enterprise teams (50+ engineers): This is where integrated platforms like Atlassian’s 2026 suite, Harness, or a custom IDP start making serious economic sense. The coordination overhead at this scale justifies the investment.

What to Actually Do This Week

Rather than overhauling everything at once, pick one bottleneck your team complains about most — slow PR reviews, flaky builds, unclear ownership, or poor documentation — and solve that single problem first. Measure the before and after. Build internal trust in tooling investment before expanding. The teams winning in 2026 aren’t necessarily using the most tools; they’re using the right tools with genuine adoption and clear ownership.

Editor’s Comment : The productivity tooling conversation in 2026 has finally matured past the hype cycle. The teams pulling ahead aren’t chasing every new AI-powered feature — they’re disciplined about integration, honest about adoption challenges, and relentlessly focused on reducing friction for their engineers. If I had one piece of advice: talk to your engineers before you buy the tool. They already know exactly where the pain is.

태그: [‘software engineering productivity 2026’, ‘developer tools 2026’, ‘engineering team productivity’, ‘DevEx tools’, ‘CI/CD optimization’, ‘developer experience platform’, ‘team productivity software’]